Les attaques des assistants vocaux par ultrasons se perfectionnent

Les cybercriminels sont de plus en plus créatifs et n’hésitent pas à s’attaquer à tous les terminaux à portée de main.

Des chercheurs américains ont ainsi démontré comment des assistants vocaux peuvent être utilisés pour lancer des attaques inaudibles via les ultrasons.

Les systèmes de reconnaissance vocale tels qu’Alexa, Cortana, Google Now ou Siri sont devenus une méthode d’interaction homme-machine de plus en plus populaire. Ils se sont pat ailleurs connectés a de à différents systèmes pilotés par la voix. Qui dit popularité, dit également montée en puissance des risques d’attaque via ces appareils. En effet, certaines commandes vocales cachées, inaudibles pour les utilisateurs, peuvent servir à contrôler les systèmes. C’est ce qu’ont démontré plusieurs chercheurs dans une étude publiée en 2017 sous le nom de DolphinAttack: Inaudible Voice Commands. Dans ce travail, ils ont donc conçu une attaque baptisée DolphinAttack, qui module les commandes vocales sur des supports ultrasoniques (en se servant d’ultrasons dont la fréquence est supérieure à 20 kHz) pour atteindre l’inaudibilité.

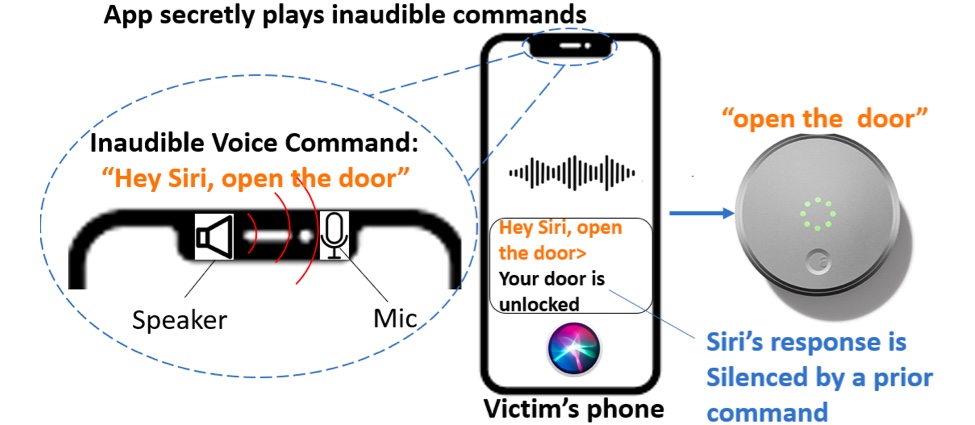

En injectant une séquence de commandes vocales inaudibles ans les assistants vocaux, l’équipe de chercheurs a pu présenter quelques attaques de démonstration, qui incluent l’activation de Siri pour lancer un appel FaceTime sur l’iPhone, l’activation de Google Now pour mettre le téléphone en mode avion, et même la manipulation du système de navigation d’une Audi. Pour éviter une utilisation abusive de DolphinAttack dans la réalité, les chercheurs proposent également deux solutions de défense aussi bien matérielle et du logicielle. Toutefois, ils suggèrent surtout de repenser les règles de contrôle des systèmes à commande vocale pour qu’ils résistent aux attaques par ultrasons. L’histoire se répète aujourd’hui puisque des chercheurs américains ont développé une attaque appelée Near-Ultrasound Inaudible Trojan (Nuit) qui peut lancer une offensive silencieuse contre des appareils alimentés par des assistants vocaux, comme les smartphones, les haut-parleurs connectés et d’autres appareils IoT.

L’IoT, cible de choix pour les cybercriminels

Une équipe de trois chercheurs, composée du professeur Guenevere Chen de l’Université du Texas à San Antonio (UTSA), de son doctorant Qi Xia et du professeur Shouhuai Xu de l’Université du Colorado (UCCS), a démontré des attaques Nuit contre des assistants vocaux présents dans des millions d’appareils, y compris Siri d’Apple, l’assistant de Google, Cortana de Microsoft et Alexa d’Amazon. Pouvant être menée à distance via Internet, l’attaque Nuit apparaît comme un clip sonore dans la gamme de fréquences proches des ultrasons (16kHz-20kHz) et peut être joué sur le haut-parleur de la victime pour toucher l’assistant vocal sur le même appareil (Nuit-1) ou sur d’autres appareils de la victime.

Dans le cas de l’attaque Nuit-2 entre deux téléphones, le premier appareil fonctionne comme l’appareil attaquant ou le haut-parleur. L’appareil 2 est le terminal victime, dont les assistants vocaux sont la cible des attaques Nuit-2.

Les chercheurs ont dressé une liste d’exemples d’attaques sur différents terminaux et avec diverses approches. Ainsi, Nuit peut être intégré à des sites Web qui lisent des médias ou des vidéos YouTube. En ce sens, inciter des cibles à visiter ces sites ou à lire des médias malveillants sur des sites fiables est un cas relativement simple d’ingénierie sociale. « Si vous lisez YouTube sur votre smart TV, cette smart TV a un haut-parleur, n’est-ce pas ? Le son des commandes malveillantes NUIT deviendra inaudible, et il peut également attaquer votre téléphone portable et communiquer avec votre assistant Google ou vos appareils Alexa », a expliqué la chercheuse Guenevere Chen. Autre fait marquant : « Cela peut même arriver dans Zoom pendant les réunions » ajoute-t-elle. Pour se protéger contre ce type d’attaque, il est vivement recommandé de s’authentifier sur tout appareil à l’aide de son empreinte vocale. Guenevere Chen conseille également aux utilisateurs de surveiller de près les terminaux pour les activations de microphone, qui ont des indicateurs dédiés à l’écran sur les smartphones iOS et Android. Enfin, les écouteurs doivent être privilégiés par rapport aux haut-parleurs. Les chercheurs prévoient de présenter plus en détails leur recherches sur l’attaque Nuit lors du 32e USENIX Security Symposium prévu du 9 au 11 août prochain à Anaheim en Californie.